当前位置:网站首页>CVPR2022 | 可精簡域適應

CVPR2022 | 可精簡域適應

2022-06-24 14:30:00 【科技新語】

背景

深度神經網絡通常對離線采集的圖像(標記的源數據)進行訓練,然後嵌入到邊緣設備中,以測試從新場景中采集的圖像(未標記的目標數據)。在實踐中,這種模式由於域轉移而降低了網絡性能。近年來,越來越多的研究者對無監督領域適應(UDA)進行了深入研究,以解决這一問題。

Vanilla UDA旨在將源數據和目標數據對齊到聯合錶示空間中,以便根據源數據訓練的模型可以很好地推廣到目標數據。但是,學術研究與工業需求之間仍然存在差距:大多數現有的UDA方法僅使用固定的神經結構進行權重自適應,但無法有效地滿足現實世界應用中各種設備的要求。

以圖1所示的廣泛使用的應用場景為例,在這種情况下,普通UDA方法必須反複訓練一系列具有不同容量和體系結構的模型,以滿足具有不同計算預算的設備的需求,這既昂貴又耗時。

為了解决上述問題,作者提出了Slimmable Domain Adaption(SlimDA),即只對模型進行一次訓練,這樣就可以靈活地從中抽取具有不同容量和體系結構的定制模型,以滿足不同計算預算的設備的需求。

圖1 SlimDA

當纖細的神經網絡滿足無監督領域自適應時,仍然存在兩個挑戰:

1)權重自適應:如何同時提高模型庫中所有模型的自適應性能。

2) 架構適應:給定特定的計算預算,如何在未標記的目標數據上搜索適當的模型。

對於第一個挑戰,作者提出了隨機集成蒸餾(SEED)來交互模型庫中的模型,以抑制模型內自適應對未標記目標數據的不確定性。錶1顯示了SEED和傳統知識蒸餾之間的差异。

錶1 傳統知識蒸餾(CKD)與隨機集成蒸餾(SEED)

對於第二個挑戰,作者提出了一種無監督的績效評估指標,可以緩解候選模型和錨模型之間的輸出差异。度量值越小,假設性能越好。

貢獻

1.提出了SlimDA,一個“一勞永逸”的框架,以共同適應資源有限設備的適應性能和計算預算。

2.提出了SEED,能够同時提高模型庫中所有模型的適應性能。

3.設計了一個優化分離的三分類器來調節模型內適應和模型間交互之間的優化。

4.提出了一種無監督的性能評估指標,以促進架構適應。

相關方法

1.無監督域自適應(UDA)

現有的UDA方法旨在提高模型在未標記目標域上的性能。在過去幾年中,提出了基於差异的方法和對抗性優化方法,通過域對齊來解决這個問題。SymNet開發了一種雙分類器體系結構,以促進類別級領域混淆。最近,Li等人試圖學習最佳架構,以進一步提高目標域的性能,這證明了網絡架構對UDA的重要性。這些UDA方法側重於實現在目標域上具有更好性能的特定模型。

2. 神經架構搜索(NAS)

NAS方法旨在通過强化學習、進化方法、基於梯度的方法等自動搜索最優架構。最近,一次性方法非常流行,因為只需要訓練一個超級網絡,並且同時優化了各種架構的多個權重共享子網絡。這樣,就可以從模型庫中搜索最優的網絡結構。在本文中,作者强調UDA對於NAS來說是一個未被注意到但意義重大的場景,因為它們可以在無監督的情况下合作優化特定於場景的輕量級體系結構。

3.跨域網絡壓縮

Chen等人提出了一種跨域非結構化剪枝方法。Y u等人采用MMD來最小化域差异,並在基於泰勒的策略中修剪過濾器,Yang等人專注於壓縮圖神經網絡。Feng等人在通道修剪網絡和全尺寸網絡之間進行對抗性訓練。然而,現有方法的性能仍有很大的改進空間。此外,他們的方法不够靈活,無法在不同的資源約束下獲得眾多的最優模型。

方法

1. SlimDA框架

在可精簡的神經網絡中已經證明,具有不同寬度(即層通道)的眾多網絡可以耦合到權重共享模型庫中,並同時進行優化。從一個基線開始,在此基線中,SymNet直接與纖細的神經網絡合並。

為了簡單起見,SymNet的總體目標統一為Ldc。在每次訓練迭代中,可以從模型庫{(Fj,Csj,Ctj)}mj=1中隨機抽樣幾個模型∈(F,Cs,Ct),命名為模型批次,其中m錶示模型批次大小。此處(F、Cs、Ct)可被視為最大模型,其餘模型可通過權重共享的方式從中采樣。

為了確保模型庫能够得到充分的訓練,應在每次訓練迭代中對最大和最小的模型進行采樣,並將其構成模型批的一部分。

該基線可被視為Eqn的兩個交替過程。為了鼓勵上述基線中的模型間交互,作者提出了SlimDA框架,如圖2所示。該框架由隨機集成蒸餾(SEED)和優化分離三分類器(OSTC)設計組成。

SEED旨在利用模型庫中的互補知識進行多模型交互。Cs和Ct分類器上的紅色箭頭錶示領域混淆訓練Ldc和模型庫中的知識聚合。Ca分類器上的紫色箭頭錶示種子優化Lseed。

圖2 SlimDA框架

2. 隨機集成蒸餾(SEED)

SEED旨在利用模型庫中的互補知識進行多模型交互。模型庫中的不同模型可以直觀地學習有關未標記目標數據的補充知識。受帶有模型擾動的貝葉斯學習的啟發,作者通過蒙特卡羅采樣利用模型庫中的模型來抑制未標記目標數據的不確定性。

模型置信度定義:

銳化函數以誘導種子訓練期間的隱式熵最小化:

3. 優化分離三分類器(OSTC)

其中前兩個用於域混淆訓練,最後一個用於接收隨機聚合的知識以進行蒸餾。蒸餾損失公式如下:

4. 無監督性能評估指標

無監督績效評估指標(UPEM):

边栏推荐

- IList of PostgreSQL

- R language plot visualization: the visualization model creates a grid in the classification contour (contour) and meshgrid of the entire data space, in which the distance between each point is determi

- 时间同步业务的闭环管理——时间监测

- Method after charging the idea plug-in material theme UI

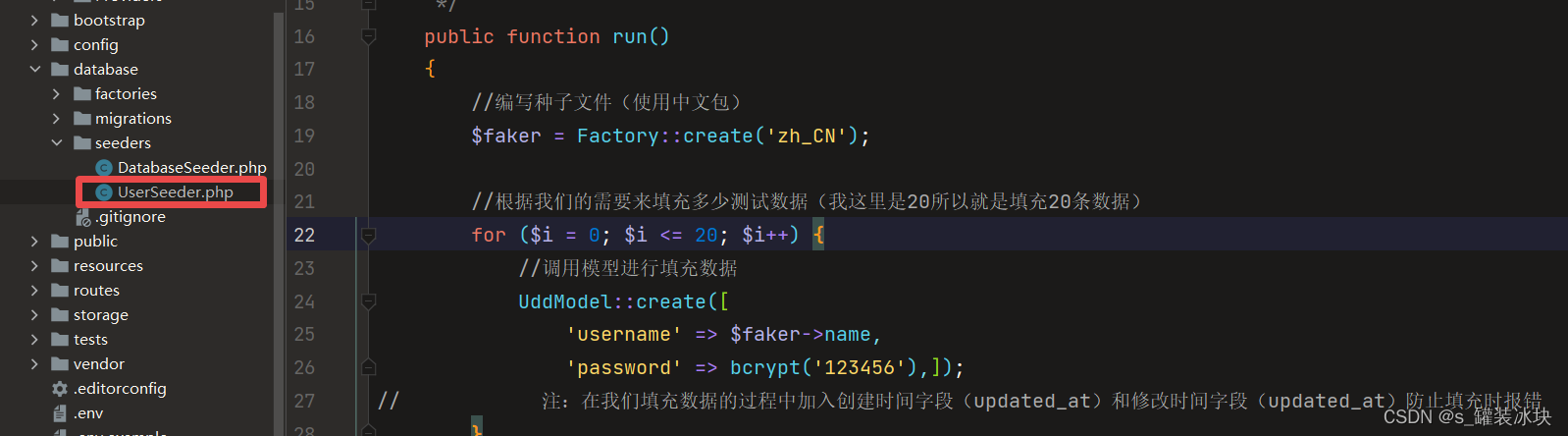

- Laravel 8 realizes auth login

- Overview of SAP marketing cloud functions (IV)

- 一文搞定 UDP 和 TCP 高频面试题!

- 探索云原生数据库,纵观未来科技发展

- 怎样评价国产报表工具和BI软件

- Linux Installation cenos7 MySQL - 8.0.26

猜你喜欢

I have been in the industry for 4 years and have changed jobs twice. I have learned a lot about software testing

不要小看了积分商城,它的作用可以很大

业务与技术双向结合构建银行数据安全管理体系

Laravel8 uses faker to call factory to fill data

leetcode:1504. Count the number of all 1 sub rectangles

Method of establishing unity thermodynamic diagram

PgSQL queries the largest or smallest data of a field in a group

Method of inputting dots under letters in markdown/latex

Daily knowledge popularization

同样是初级测试工程师,为啥他薪资高?会这几点面试必定出彩

随机推荐

Brief discussion on the implementation framework of enterprise power Bi CI /cd

在同花顺开户证券安全吗,需要什么准备

[untitled]

数据库注意事项

v-if 和 v-show 的区别

[leetcode] 10. Regular expression matching

Laravel 8 realizes auth login

C language ---18 function (user-defined function)

Some basic database operations (providing the original database information)

R语言实战应用精讲50篇(二十三)-贝叶斯理论重要概念: 可信度Credibility, 模型Models, 和参数Parameters

Alibaba OSS object storage service

缓存使用中Redis,Memcached的共性和差异分析

leetcode.12 --- 整数转罗马数字

Qunhui synchronizes with alicloud OSS

入行 4 年,跳槽 2 次,我摸透了软件测试这一行

09_一种比较高效的记忆方法

[deep learning] storage form of nchw, nhwc and chwn format data

Common sense knowledge points

【Pytorch】量化

六月集训(第24天) —— 线段树